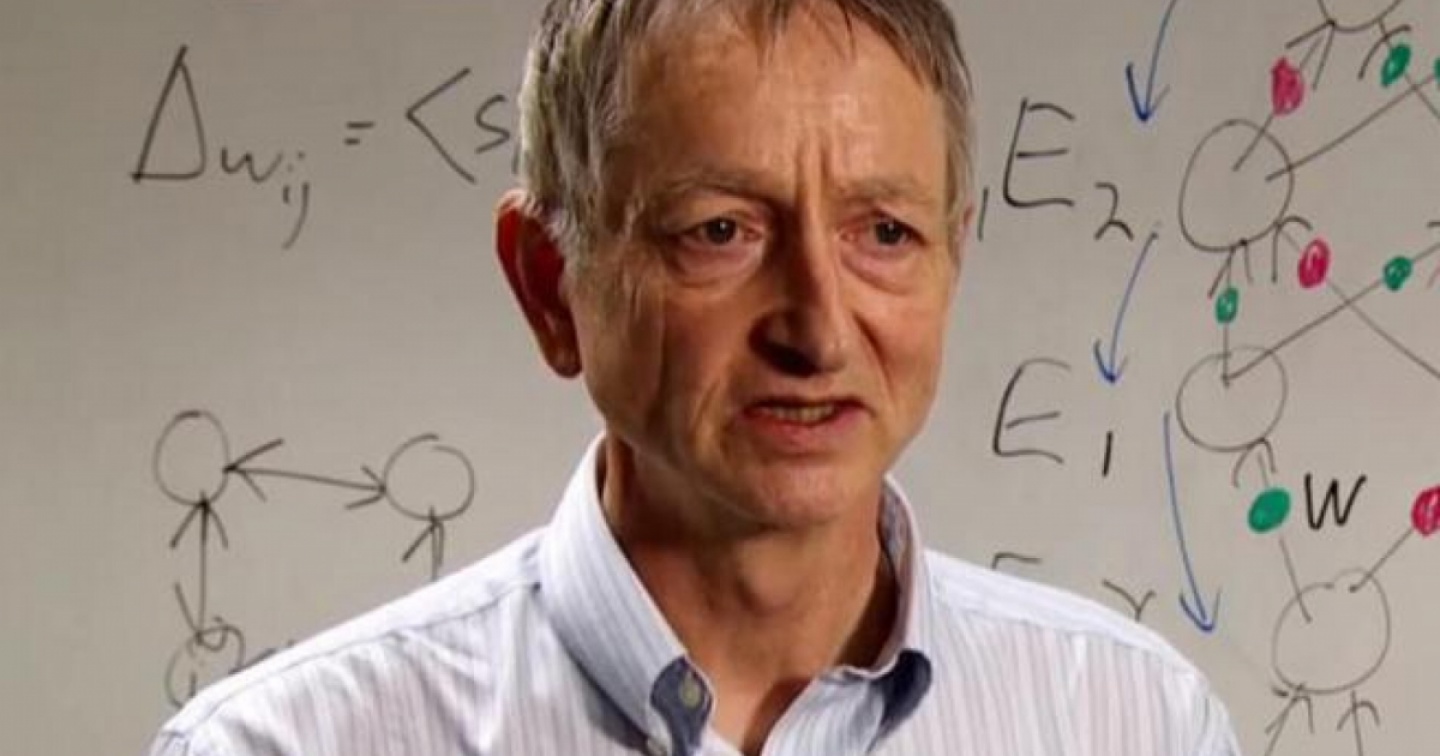

Il padrino dell'IA lascia Google, ‘troppi pericoli’

Geoffrey Hinton, considerato il padrino dell'intelligenza artificiale, si è dimesso dopo 10 anni, intravvedendo troppi rischi in questa ricerca

Geoffrey Hinton, considerato il padrino dell'intelligenza artificiale, si è dimesso dopo 10 anni da Google lanciando un nuovo allarme sui crescenti pericoli dell'IA, dalla disinformazione ai posti di lavoro sino alla scomparsa dell'umanità.

Lo scienziato ha spiegato di essersi licenziato per poter parlare liberamente di questi rischi, pur non criticando il gigante tech ma anzi sottolineando che è stato "molto responsabile". Tuttavia ha ammesso che una parte di sé ora si rammarica del suo lavoro, anche se si consola "con la solita scusa: se non avessi fatto quello che ho fatto, l'avrebbe fatto qualcun altro".

Britannico di nascita ma con passaporto canadese, 75 anni, è un pioniere della ricerca sulle reti neurali e sul "deep learning" che gli hanno fatto vincere nel 2018 il prestigioso premio Turing Award e che hanno spianato la strada ai sistemi d'intelligenza artificiali. Era entrato in Google nel 2013, dopo che Big G si era comprata una società fondata da lui e due suoi studenti (uno dei due è Ilya Sutskever, che oggi lavora per OpenAI): i tre avevano sviluppato una rete neurale che imparava da sola a identificare oggetti comuni dopo aver analizzato migliaia di foto. Da allora i programmi dell'AI hanno fatto passi da gigante e ora, mette in guardia, sono "piuttosto spaventosi".

‘Presto saranno più intelligenti di noi’

"Adesso non sono più intelligenti di noi, per quanto ne so. Ma penso che presto potrebbero esserlo", ha ammonito prefigurando scenari sino a poco tempo fa solo da fantascienza. Lo psicologo cognitivo e scienziato informatico ha spiegato alla Bbc che il chatbot potrebbe presto superare il livello d'informazioni di un cervello umano. "In questo momento - ha osservato - quello che stiamo vedendo è che cose come GPT-4 oscurano una persona nella quantità di conoscenza generale che ha e la oscura di gran lunga. In termini di ragionamento, non è così buono, ma fa già un semplice ragionamento. E dato il ritmo dei progressi, ci aspettiamo che le cose migliorino abbastanza velocemente. Quindi dobbiamo preoccuparcene". Hinton ha evocato il rischio di "attori cattivi" che potrebbero tentare di usare l'IA per "cose cattive". "Questo è solo una specie di scenario peggiore, una specie di scenario da incubo", ha precisato facendo un esempio con il presidente russo: "Potete immaginare un cattivo attore come Putin che decida di dare ai robot la capacità di creare propri sotto-obiettivi", come quelli di "ottenere più potere". Lo scienziato inoltre è arrivato alla conclusione che "il tipo d'intelligenza che stiamo sviluppando è molto differente dall'intelligenza che abbiamo noi". "Noi - ha spiegato - siamo sistemi biologici mentre questi sono sistemi digitali. E la grande differenza è che con i sistemi digitali hai molte copie uguali. E tutte queste copie possono imparare separatamente ma condividere le loro conoscenze all'istante. Quindi è come se avessi 10.000 persone e ogni volta che una persona ha imparato qualcosa, tutti lo sapessero automaticamente. Ed è così che questi chatbot possono sapere molto di più di qualsiasi persona".

Il suo allarme segue quello di oltre mille dirigenti e ricercatori del settore, tra cui Elon Musk, che dopo la diffusione a marzo di ChatGpt da parte della start-up OpenAi hanno chiesto in una lettera aperta una moratoria di sei mesi nello sviluppo dell'intelligenza artificiale per i "profondi rischi alla società e all'umanita'". Hinton ritiene però che sia difficile sospenderne lo sviluppo, data la concorrenza internazionale, e che comunque non bisogna fermarlo ma regolamentarlo perchè "nel breve termine" vede più benefici che rischi. Un compito, ha aggiunto, che spetta alla politica.

La sfida è stata subito raccolta dal commissario Ue per l'Economia, Paolo Gentiloni: "Le dimissioni di Geoffrey Hinton da Google rilanciano la discussione sull'Intelligenza Artificiale. Grandi potenzialità, ad esempio per la salute. Ma anche rischi. L'Europa lavora per regole del gioco efficaci", ha twittato.